Compare commits

201 Commits

| Author | SHA1 | Date | |

|---|---|---|---|

|

|

2c8c8554a1 | ||

|

|

b8621bc96f | ||

|

|

b74f663f2a | ||

|

|

0ba01b97af | ||

|

|

2101d75ae5 | ||

|

|

40dfd1d680 | ||

|

|

a1bed65c4e | ||

|

|

15b7ce02cc | ||

|

|

08a02bf36b | ||

|

|

9138bb2ce1 | ||

|

|

55bc6115c1 | ||

|

|

4b9ca03461 | ||

|

|

26b1849865 | ||

|

|

adffca68db | ||

|

|

970f3de5f1 | ||

|

|

a0cb818eb9 | ||

|

|

c6012979ff | ||

|

|

792b1ac2e7 | ||

|

|

66d9c3f386 | ||

|

|

c2c39c92f9 | ||

|

|

a41c897d7b | ||

|

|

086021b698 | ||

|

|

07c8e09f32 | ||

|

|

2676c1e81b | ||

|

|

c8dd109902 | ||

|

|

7b6cb717c4 | ||

|

|

b6f09f6b5c | ||

|

|

8dcad5653c | ||

|

|

5e031a10e9 | ||

|

|

987aaa27f3 | ||

|

|

5e6683b881 | ||

|

|

7cd739b465 | ||

|

|

9a4d9de772 | ||

|

|

972730cadc | ||

|

|

7866873bc5 | ||

|

|

04d8748ef2 | ||

|

|

1ff51be895 | ||

|

|

dc1fa8c4bf | ||

|

|

5f7454c357 | ||

|

|

91b9acfd8d | ||

|

|

a98483331b | ||

|

|

52d8ef7f63 | ||

|

|

0cc5617bae | ||

|

|

273ccdc0f8 | ||

|

|

0aceaf4836 | ||

|

|

69b0203c6a | ||

|

|

cf1b86367b | ||

|

|

b9ac0235fb | ||

|

|

0953479793 | ||

|

|

3cdc597255 | ||

|

|

6142a653b5 | ||

|

|

6aa8fcfb4f | ||

|

|

1c32794d03 | ||

|

|

4e2b5feed0 | ||

|

|

9f7cec43aa | ||

|

|

58fc60c88d | ||

|

|

b44201333d | ||

|

|

32556e1f3c | ||

|

|

77be1b4aca | ||

|

|

55f38bbc4a | ||

|

|

d09cbc9c86 | ||

|

|

3a81d29335 | ||

|

|

7c47040f78 | ||

|

|

dcfbe54e28 | ||

|

|

7f482e3a6f | ||

|

|

2617f527c5 | ||

|

|

83819bbfca | ||

|

|

11f71311fe | ||

|

|

d7b78ee6c8 | ||

|

|

9178b55bb0 | ||

|

|

c305aeca13 | ||

|

|

8ee8d2e88f | ||

|

|

657f4bc155 | ||

|

|

d94ae9ca51 | ||

|

|

469e9ee681 | ||

|

|

aacc1c2a6f | ||

|

|

49c4a3bbcb | ||

|

|

a32b5b4f50 | ||

|

|

c8e9c729b0 | ||

|

|

8f20764b8a | ||

|

|

a393b18736 | ||

|

|

f3907b38b2 | ||

|

|

28aadc87f8 | ||

|

|

dfed333f09 | ||

|

|

5a766e5481 | ||

|

|

aae6483340 | ||

|

|

74574e671e | ||

|

|

4e7d52f36b | ||

|

|

9ac85233f4 | ||

|

|

7203ea49d1 | ||

|

|

a6b4380476 | ||

|

|

a0abc8bb4b | ||

|

|

798ddd0b2b | ||

|

|

cf217973a3 | ||

|

|

4c4a15b2b7 | ||

|

|

45f285a0a0 | ||

|

|

3cb769814b | ||

|

|

831b959613 | ||

|

|

038f95a51b | ||

|

|

149aa92334 | ||

|

|

ebc133ae0a | ||

|

|

5234055ee8 | ||

|

|

9e291f7563 | ||

|

|

db2a3f00bc | ||

|

|

4f91abcafb | ||

|

|

d8cacd9fa9 | ||

|

|

11f0aa9786 | ||

|

|

0f86bbe237 | ||

|

|

c15430a58f | ||

|

|

3bc52657ba | ||

|

|

2859c8cbae | ||

|

|

6e1f0b29ee | ||

|

|

5c26087ad7 | ||

|

|

7b7c072298 | ||

|

|

f86a50e6a4 | ||

| 26829ab465 | |||

|

|

f3004263a5 | ||

| 65acb2786e | |||

|

|

4f93b5cc93 | ||

|

|

f89a8ab627 | ||

|

|

8c9d130726 | ||

|

|

494e88371a | ||

|

|

a1284fd255 | ||

|

|

c2c5070b05 | ||

| 982d04a180 | |||

|

|

8e2b536403 | ||

|

|

6127b5d72f | ||

|

|

456e458d66 | ||

|

|

635fab4fed | ||

|

|

4169275975 | ||

|

|

003a620311 | ||

|

|

06bec526f4 | ||

|

|

91eb770bbc | ||

|

|

cadddbba8c | ||

|

|

622e702593 | ||

|

|

ca03654289 | ||

|

|

412200f0eb | ||

|

|

c62d3560a7 | ||

|

|

dc5ca64239 | ||

|

|

c3cbb59313 | ||

|

|

25e5ee53f9 | ||

|

|

5157c5b1e6 | ||

|

|

b6ee67986c | ||

|

|

3cec052076 | ||

|

|

4458435e73 | ||

|

|

685c287958 | ||

|

|

158fa02ca8 | ||

|

|

f0ddecbe60 | ||

|

|

b6078c67b2 | ||

|

|

8d602f823a | ||

|

|

967277e2df | ||

|

|

1974ec3497 | ||

|

|

33df15372a | ||

|

|

59b0138f70 | ||

|

|

5b0e0b38fd | ||

|

|

8674de4dbd | ||

|

|

0b2f04bbbd | ||

|

|

8056c7de4a | ||

|

|

dcfdab41fe | ||

|

|

8f17b63bb3 | ||

|

|

6bf75becd0 | ||

|

|

d94cd76652 | ||

|

|

e7315025ea | ||

|

|

730d97071f | ||

|

|

cf0553d8b6 | ||

|

|

9b434b62f8 | ||

|

|

f4db40843d | ||

|

|

5787e0d1c5 | ||

|

|

986515a78d | ||

|

|

c35df9d9fa | ||

|

|

b42cdbb167 | ||

|

|

b82af10126 | ||

|

|

1744878fa0 | ||

|

|

46f9ea9a4f | ||

|

|

61a8f5ad5f | ||

|

|

6b09c3f2cb | ||

|

|

f614230af6 | ||

|

|

576207a714 | ||

|

|

faff475592 | ||

|

|

0e52c49b37 | ||

|

|

0c8a9f5cce | ||

|

|

36e58ee77b | ||

|

|

f2ff641e9d | ||

|

|

f5d386399f | ||

|

|

ec0eb8e814 | ||

|

|

4037484275 | ||

|

|

29ff59fb64 | ||

|

|

72c99368c7 | ||

|

|

23513c8c5e | ||

|

|

fb252d0c99 | ||

|

|

739407f979 | ||

|

|

5b993f7ce0 | ||

|

|

1dafb124a5 | ||

|

|

fe1d769020 | ||

|

|

5d80340197 | ||

|

|

c0f730fa62 | ||

|

|

9f4d161b6c | ||

|

|

d59c61bf48 | ||

|

|

e57048e21f | ||

|

|

fc52719fda | ||

|

|

24e3c83c11 |

@ -1,138 +1,136 @@

|

||||

# Technische Grundlagen

|

||||

|

||||

* Schaubild zu Lehrinhalten

|

||||

* Einrichtung der Arbeitsumgebung (Linux)

|

||||

* Grundlagen der Unix Shell

|

||||

* Versionskontrolle mit Git

|

||||

* Versionskontrolle mit git

|

||||

* Blog mit GitHub Pages

|

||||

|

||||

|

||||

|

||||

erstellt mit [mermaid](https://mermaidjs.github.io/mermaid-live-editor/)

|

||||

|

||||

Note:

|

||||

- Den heutigen Tag werden wir vor allem mit allgemeinen technischen Grundlagen verbringen.

|

||||

- Als Arbeitsumgebung verwenden wir ein Linux-Betriebssystem auf einer virtuellen Maschine. Im [vorigen Semester](https://github.com/felixlohmeier/bibliotheks-und-archivinformatik/releases/tag/v1.0) wurden im Kurs BAIN die virtuellen Maschinen lokal auf den Laptops der Studierenden mit [VirtualBox](https://www.virtualbox.org) installiert. Dabei treten aber in 1-2 von 10 Fällen Probleme in Verbindung mit BIOS/UEFI-Einstellungen, Sicherheitsfeatures und teilweise vorinstallierten Windows-Services (Hyper-V) auf.

|

||||

- Die Unix Shell werden wir im Kurs öfter für Installation und Konfiguration der Software verwenden. Daher beginnen wir hier mit einer Wiederholung der wichtigsten Kommandos, damit uns das später leichter fällt.

|

||||

- Durch die Plattform GitHub, auf der Informatiker\*innen Ihren Quellcode ablegen, ist das Versionskontrollsystem Git sehr populär geworden. Es ist nicht nur für die Entwicklung von Software, sondern generell für die Zusammenarbeit in Projekten extrem hilfreich.

|

||||

- Die Übungen zu Unix Shell und Git basieren auf den Lehrmaterialien von [Library Carpentry](https://librarycarpentry.org/). Wer von Ihnen hat davon schon einmal gehört? Ggf. Lessons auf der Webseite zeigen.

|

||||

- In diesem Schaubild sind links die Lokalsysteme (Bibliothekssytem Koha, Archivinformationssystem ArchivesSpace, Repository-Software DSpace) aufgeführt. Diese bieten jeweils eine OAI-Schnittstelle an.

|

||||

- Mit einer speziellen Software (hier: VuFindHarvest) werden die Metadaten im jeweils spezifischen Format eingesammelt. Über einen XSLT Crosswalk werden die Daten dann einheitlich in MARC21-XML überführt. Zusätzlich werden Tabellendaten (CSV) mit OpenRefine ebenfalls in MARC21-XML transformiert.

|

||||

- Abschließend werden alle MARC21-XML-Daten in die Discovery-Lösung VuFind eingespielt.

|

||||

- Wir lernen die Systeme, Schnittstellen, Tools und Formate Schritt für Schritt kennen. Am Ende des Kurses sollten Sie das Schaubild dann in eigenen Worten erklären können.

|

||||

|

||||

## Einrichtung der Arbeitsumgebung (Linux)

|

||||

|

||||

* Wir verwenden virtuelle Maschinen der Cloud-Plattform Microsoft Azure.

|

||||

* Auf den virtuellen Maschinen ist das Linux-Betriebssystem [Ubuntu 19.10 Server](https://wiki.ubuntu.com/EoanErmine/ReleaseNotes) mit der Oberfläche [XFCE](https://www.xfce.org) installiert.

|

||||

* Sie erhalten alle eine eigene virtuelle Maschine, die Sie auch "kaputtspielen" dürfen.

|

||||

### Arbeitsumgebung

|

||||

|

||||

* Jede/r erhält eine virtuelle Maschine der FH Graubünden mit Ubuntu Linux.

|

||||

* Sie haben volle Administrationsrechte.

|

||||

* Dozenten haben zur Unterstützung und Fehlerbehebung ebenfalls Zugriff darauf.

|

||||

|

||||

### Linux

|

||||

|

||||

* Die meisten Webserver laufen auf Linux.

|

||||

* Wir verwenden [Ubuntu](https://ubuntu.com) in der Version 20.04 LTS.

|

||||

* Ubuntu basiert wiederum auf [Debian](https://www.debian.org). Die ganze Familiengeschichte: [GNU/Linux Distributions Timeline](https://upload.wikimedia.org/wikipedia/commons/1/1b/Linux_Distribution_Timeline.svg)

|

||||

|

||||

Note:

|

||||

- Normalerweise werden Linux-Server aus Sicherheitsgründen ohne grafische Oberfläche administriert, also nur über die Kommandozeile. Wir verwenden hier XFCE (extra leichtgewichtig, es gibt hübschere Linux-Desktops...), um den Einstieg zu erleichtern.

|

||||

- "Kaputtspielen" bedeutet, dass die virtuelle Maschine einfach von mir auf den Ausgangszustand zurückgesetzt werden kann, wenn etwas schief geht. Scheuen Sie sich also nicht davor etwas auszuprobieren.

|

||||

- Ausschlaggebende Gründe für Verwendung von [Microsoft Azure Lab Services](https://azure.microsoft.com/de-de/services/lab-services/) gegenüber anderen Plattformen:

|

||||

- Studierende müssen nur wenig Daten preisgeben (Microsoft-Konto, aber keine Zahlungsdaten)

|

||||

- Studierende können virtuelle Maschinen über eine einfach gehaltene Oberfläche selbst starten und stoppen.

|

||||

- Kosten entstehen nur für tatsächlich genutzte Zeit und nicht im ausgeschalteten Zustand.

|

||||

- Anleitung für Lehrende: [Azure Lab einrichten](https://bain.felixlohmeier.de/#/azure-lab-einrichten)

|

||||

- Normalerweise werden Linux-Server aus Sicherheitsgründen ohne grafische Oberfläche administriert, also nur über die Kommandozeile.

|

||||

|

||||

### Registrierung im Lab

|

||||

### Zugriff auf die virtuelle Maschine

|

||||

|

||||

* Sie erhalten jetzt einen Registrierungslink an Ihre E-Mail-Adresse.

|

||||

* Nach Login unter <https://labs.azure.com> sollte es so ähnlich aussehen:

|

||||

|

||||

1. Mit dem Netzwerk der FHGR verbinden (ggf. via VPN)

|

||||

2. <https://horizon.fhgr.ch> aufrufen

|

||||

3. Zugriff auf die virtuelle Maschine (Ubuntu) entweder direkt über den Browser (HTML5) oder über eine Zusatzsoftware (Horizon Client)

|

||||

|

||||

Sie können sich an allen drei Punkten (VPN, Horizon und Ubuntu) mit Ihrem persönlichen FHGR-Konto anmelden. Achtung: Beim Anmeldebildschirm von Ubuntu ist ein US-Tastaturlayout eingestellt.

|

||||

|

||||

Note:

|

||||

- Memo für Lehrende: Jetzt in Azure Lab Services einloggen, alle VMs starten und Registrierungslinks versenden.

|

||||

- Es ist erforderlich, dass Sie im Zuge der Registrierung ein persönliches Microsoft-Konto einrichten oder ihre E-Mail-Adresse mit einem vorhandenen persönlichen Microsoft-Konto verbinden. Das lässt sich leider nicht vermeiden. Es müssen dabei E-Mail, Name und Geburtsdatum angegeben werden.

|

||||

- Falls Sie nach dem Login erneut auf der Startseite der Lab Services landen:

|

||||

* Abmelden

|

||||

* Browser schließen

|

||||

* Browser neu starten

|

||||

* Seite <https://labs.azure.com> aufrufen und erneut anmelden.

|

||||

- Bei Wikimedia Commons gibt es ein Bild des US-Tastaturlayouts: <https://commons.wikimedia.org/wiki/File:KB_United_States.svg>

|

||||

- Copy & Paste funktioniert zuverlässiger mit der Zusatzsoftware.

|

||||

|

||||

### Verbindung mit der VM

|

||||

### Übung: Verbindung testen

|

||||

|

||||

* Nachdem die Virtuelle Maschine (VM) gestartet wurde (2-3 Minuten), können Sie über das kleine Bildschirm-Symbol die Zugangsdaten für Remote Desktop (RDP) laden.

|

||||

* Beim ersten Aufruf müssen Sie ein Passwort vergeben.

|

||||

* RDP-Datei öffnen mit:

|

||||

* Windows: Remote Desktop (vorinstalliert)

|

||||

* macOS: [Microsoft Remote Desktop 10](https://apps.apple.com/de/app/microsoft-remote-desktop-10/id1295203466) (siehe auch [Anleitung von Microsoft für macOS](https://docs.microsoft.com/de-de/azure/lab-services/classroom-labs/how-to-use-classroom-lab#connect-to-a-vm-using-rdp-on-a-mac))

|

||||

* Linux: [Remmina](https://remmina.org/)

|

||||

Bitte verbinden Sie sich jetzt mit der virtuellen Maschine. Nach dem Login sollte es etwa so aussehen:

|

||||

|

||||

|

||||

|

||||

### Grundeinstellungen

|

||||

|

||||

1. Favoriten

|

||||

* Unten links Anwendungsmenü öffnen

|

||||

* Programm suchen (`Terminal` und `Text Editor`)

|

||||

* Rechtsklick auf Icon und `Add to Favorites` wählen

|

||||

|

||||

2. Startseite im Firefox Browser

|

||||

* Die Übersichtsseite des gemeinsamen Dokuments aufrufen

|

||||

* Über das Sternchen in der Adressleiste ein Lesezeichen setzen

|

||||

|

||||

Note:

|

||||

- Während der Unterrichtszeiten starte und stoppe ich die VMs zentral.

|

||||

- Bei der Verbindung von Zuhause denken Sie bitte daran, die Maschine nach der Verwendung zu stoppen, damit keine unnötigen Kosten anfallen.

|

||||

- Das Passwort können Sie über das Zusatzmenü (drei kleine Punkte) jederzeit neu setzen.

|

||||

|

||||

### Login (Linux)

|

||||

|

||||

|

||||

|

||||

Note:

|

||||

- Benutzername: `bain`

|

||||

- Passwort: (haben Sie beim ersten Start festgelegt)

|

||||

|

||||

### Orientierung (Linux)

|

||||

|

||||

|

||||

|

||||

Note:

|

||||

- Ubuntu Server 19.10 mit XFCE

|

||||

- Benötigte Programme unten im Dock:

|

||||

1. Terminal

|

||||

2. Dateimanager (ähnlich Windows Explorer)

|

||||

3. Firefox-Browser

|

||||

4. Texteditor "Mousepad" (ähnlich Windows Notepad)

|

||||

- Herunterfahren über die Azure Labs Oberfläche unter <https://labs.azure.com> (ein `sudo poweroff` im Terminal reicht nicht aus)

|

||||

- Teilnehmer\*innen mit Mac? Dann im Applikationsmenü "Region & Language" das Keyboard Layout "German (Switzerland, Macintosh)" ergänzen und auswählen

|

||||

|

||||

## Grundlagen der Unix Shell

|

||||

|

||||

* Wird benötigt zur Administration von Servern

|

||||

* Ist aber auch zur Automatisierung von kleineren Aufgaben beliebt (Shell-Scripte)

|

||||

* Mit der Unix Shell lässt sich sogar "Text Mining" betreiben (dazu später eine kleine Übung)

|

||||

|

||||

### Download Materialien

|

||||

Note:

|

||||

- Die Unix Shell werden wir im Kurs öfter für Installation und Konfiguration der Software verwenden. Daher beginnen wir hier mit einer Wiederholung der wichtigsten Kommandos, damit uns das später leichter fällt.

|

||||

- Es gibt verschiedene Varianten der Shell. Ubuntu verwendet Bash.

|

||||

|

||||

### Download der Materialien

|

||||

|

||||

1. In das Home-Verzeichnis wechseln

|

||||

|

||||

```shell

|

||||

cd

|

||||

```

|

||||

```shell

|

||||

cd

|

||||

```

|

||||

|

||||

2. Archiv shell-lesson.zip von Library Carpentry herunterladen

|

||||

|

||||

```shell

|

||||

wget https://librarycarpentry.org/lc-shell/data/shell-lesson.zip

|

||||

```

|

||||

```shell

|

||||

wget https://librarycarpentry.org/lc-shell/data/shell-lesson.zip

|

||||

```

|

||||

|

||||

3. Archiv in den Ordner shell-lesson entpacken und Archiv löschen

|

||||

|

||||

```shell

|

||||

unzip shell-lesson.zip -d shell-lesson

|

||||

rm shell-lesson.zip

|

||||

```

|

||||

```shell

|

||||

unzip shell-lesson.zip -d shell-lesson

|

||||

rm shell-lesson.zip

|

||||

```

|

||||

|

||||

### Übungen

|

||||

|

||||

Bitte bearbeiten Sie zur Auffrischung Ihrer Shell-Kenntnisse die Kapitel 2 und 3 der Library Carpentry Lesson:

|

||||

* Kapitel 2: <https://librarycarpentry.org/lc-shell/02-navigating-the-filesystem/>

|

||||

* Kapitel 3: <https://librarycarpentry.org/lc-shell/03-working-with-files-and-folders/>

|

||||

Aufgaben:

|

||||

|

||||

### Tipps

|

||||

1. Bearbeiten Sie das zweite Kapitel [Navigating the filesystem](https://librarycarpentry.org/lc-shell/02-navigating-the-filesystem/index.html) der Library Carpentry Lesson zur Unix Shell

|

||||

2. Bearbeiten Sie das dritte Kapitel [Working with files and directories](https://librarycarpentry.org/lc-shell/03-working-with-files-and-folders/index.html) der Library Carpentry Lesson zur Unix Shell

|

||||

|

||||

* Nutzen Sie immer die Tab-Taste für die Autovervollständigung

|

||||

* Seien Sie faul, verwenden Sie Ihre persönliche Befehlshistorie (Pfeiltaste nach oben / Suche in der Historie mit `STRG`+`R`)

|

||||

### Tipps zur Unix Shell

|

||||

|

||||

* Copy & Paste im Terminal mit Rechtsklick oder STRG+SHIFT+C und STRG+SHIFT+V

|

||||

* Nutzen Sie immer die Tab-Taste für die Autovervollständigung.

|

||||

* Seien Sie faul, verwenden Sie Ihre persönliche Befehlshistorie (Pfeiltaste nach oben / Suche in der Historie mit `STRG`+`R`).

|

||||

* Wichtig ist die Unterscheidung zwischen Programm (`ls`) und Parametern (`-l`).

|

||||

* Nutzen Sie Spickzettel für die wichtigsten Kommandos wie z.B. [Library Carpentry Reference](https://librarycarpentry.org/lc-shell/reference.html) oder [Cheatsheet für Shell-Scripte](https://devhints.io/bash)

|

||||

* Nutzen Sie Spickzettel für die wichtigsten Kommandos wie z.B. [Library Carpentry Reference](https://librarycarpentry.org/lc-shell/reference.html) oder [Cheatsheet für Shell-Scripte](https://devhints.io/bash).

|

||||

|

||||

Note:

|

||||

- Alle Programme in der Unix Shell sind ähnlich aufgebaut. Wenn Sie das Grundprinzip mit der Unterscheidung von Programm und Parametern verinnerlicht haben, dann hilft Ihnen auch die integrierte Hilfe (`--help`) weiter.

|

||||

- Linux hat ein integriertes Nutzerhandbuch, das zu beinahe jedem Kommando und Programm hilfreiche Dokumentation enthält: man <command> (auch via Google)

|

||||

|

||||

### Redirects und Pipes

|

||||

|

||||

|

||||

|

||||

|

||||

Note:

|

||||

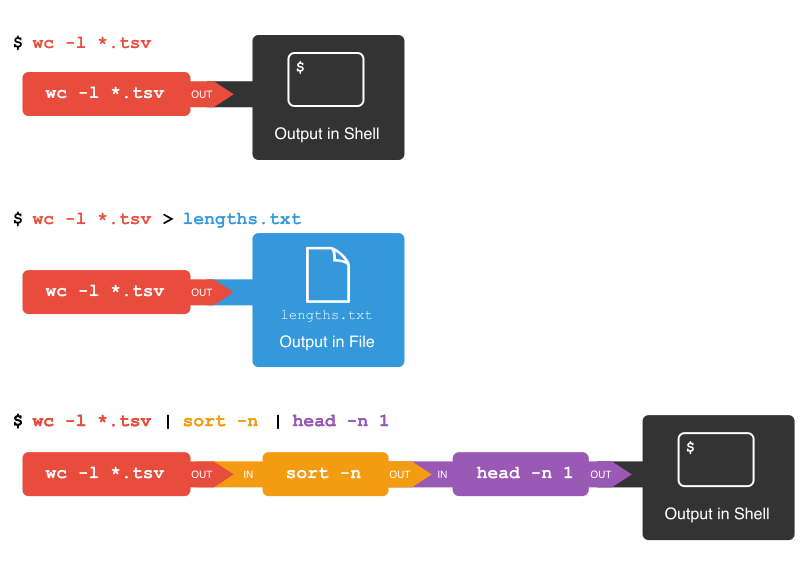

1. Bei einer normalen Eingabe landet das Ergebnis im Terminal. `wc` steht für "word count" und liefert mit dem Parameter `-l` die Anzahl der Zeilen. Die Angabe `*.tsv` bedeutet alle Dateien mit der Dateiendung "tsv".

|

||||

2. Stattdessen kann das Ergebnis aber auch in eine Datei umgelenkt werden mit der spitzen Klammer `>`

|

||||

3. Das Ergebnis eines Programms kann mit "Pipes" (`|`) direkt weiterverarbeitet werden. Welche Ausgabe erwarten Sie?

|

||||

|

||||

## Versionskontrolle mit Git

|

||||

## Versionskontrolle mit git

|

||||

|

||||

* Aus Zeitgründen schauen wir uns nur kurz gemeinsam einige Grundfunktionen von `git` an.

|

||||

* Aus Zeitgründen schauen wir uns nur Grundfunktionen von `git` an.

|

||||

* Wenn Sie im Anschluss selbst üben möchten, bietet Library Carpentry dazu [ausführliche Lehrmaterialien](<https://librarycarpentry.org/lc-git/>)

|

||||

|

||||

Note:

|

||||

- Durch die Plattform GitHub, auf der Informatiker\*innen Ihren Quellcode ablegen, ist das Versionskontrollsystem Git sehr populär geworden. Es ist nicht nur für die Entwicklung von Software, sondern generell für die Zusammenarbeit in Projekten extrem hilfreich.

|

||||

|

||||

### Wozu Git?

|

||||

|

||||

* Git ist eine Software zur Versionskontrolle

|

||||

@ -146,7 +144,7 @@ Note:

|

||||

### Unterschied Git und GitHub

|

||||

|

||||

* Git kann zunächst auch lokal auf einem Computer verwendet werden.

|

||||

* Wenn ein Git Repository im Netz bereitgestellt werden soll, braucht es eine Installation von git auf einem Webserver.

|

||||

* Wenn ein Git Repository im Netz bereitgestellt werden soll, braucht es eine Installation von Git auf einem Webserver.

|

||||

* Das kann man selber machen oder eine Plattform nutzen. Die bekannteste ist [GitHub](https://www.github.com).

|

||||

|

||||

Note:

|

||||

@ -154,123 +152,143 @@ Note:

|

||||

- Alternativen zu GitHub sind unter anderem [GitLab](https://gitlab.com), [BitBucket](https://bitbucket.org) oder auch das Urgestein [SourceForge](https://sourceforge.net).

|

||||

- Viele Bibliotheken nutzen GitHub oder GitLab. Es gibt eine gemeinschaftlich gepflegte Liste [BibsOnGitHub](https://github.com/axel-klinger/BibsOnGitHub), auf der [Listen von Bibliotheken](https://axel-klinger.github.io/BibsOnGitHub/libraries.html) und [deren Repositorien](https://axel-klinger.github.io/BibsOnGitHub/repositories.html) eingesehen werden können.

|

||||

|

||||

### Vorführung Grundfunktionen

|

||||

### Programme installieren

|

||||

|

||||

* Als Beispiel nutzen wir das GitHub Repository für diesen Kurs, in dem die Lehrmaterialien liegen: <https://github.com/felixlohmeier/bibliotheks-und-archivinformatik>

|

||||

* Zur Vorführung machen wir jetzt Folgendes:

|

||||

1. Die Dateien aus dem GitHub Repository herunterladen ("klonen")

|

||||

2. Eine der Textdateien verändern

|

||||

3. Die Änderung mit einer erläuternden Notiz hochladen

|

||||

1. Verzeichnis aktualisieren

|

||||

|

||||

#### Repository klonen

|

||||

```shell

|

||||

sudo apt update

|

||||

```

|

||||

|

||||

2. Programme installieren

|

||||

|

||||

```shell

|

||||

sudo apt install git curl

|

||||

```

|

||||

|

||||

Note:

|

||||

- Darauf folgt eine Passwortabfrage (nochmal das gleiche)

|

||||

- Änderungen werden komplex angezeigt, diese müssen dann nochmal mit `Y` (oder Enter) bestätigt werden

|

||||

- Die Paketverwaltung unter Linux ist vergleichbar mit einem App-Store von Apple oder Google

|

||||

|

||||

### Übung: Link zum Lerntagebuch ergänzen

|

||||

|

||||

* Als Beispiel nutzen wir das [GitHub Repository dieses Kurses](https://github.com/felixlohmeier/bibliotheks-und-archivinformatik), in dem die Lehrmaterialien liegen.

|

||||

* Sie ergänzen darin den Link zu Ihrem Lerntagebuch.

|

||||

* So gehen wir vor:

|

||||

1. Kopie des Repositories erstellen ("Fork")

|

||||

2. Dateien aus Ihrem Fork herunterladen ("clone")

|

||||

3. Link zu Ihrem Lerntagebuch in `README.md` einfügen

|

||||

4. Die Änderung mit einer Notiz hochladen ("commit")

|

||||

5. Übernahme der Änderung anfragen ("Pull request")

|

||||

|

||||

### Schritt 0: Git konfigurieren

|

||||

|

||||

Name und E-Mail für Git hinterlegen

|

||||

|

||||

```shell

|

||||

git clone https://github.com/felixlohmeier/bibliotheks-und-archivinformatik.git

|

||||

git config --global user.name "Felix Lohmeier"

|

||||

git config --global user.email "mail@felixlohmeier.de"

|

||||

```

|

||||

|

||||

|

||||

Note:

|

||||

- Ersetzen Sie die Angaben durch Ihre eigenen und verwenden Sie dieselbe E-Mail-Adresse, mit der Sie sich bei GitHub registriert haben. Dadurch kann GitHub Ihnen alle Änderungen zuordnen.

|

||||

- Die Konfiguration ist nur einmalig nötig. Sie wird in Ihrem Home-Verzeichnis gespeichert (```~/.gitconfig```) und künftig für jedes Repository automatisch als Standard verwendet.

|

||||

|

||||

#### Änderung mit Texteditor

|

||||

#### Schritt 1: Kopie des Repositories erstellen

|

||||

|

||||

* Bei GitHub einloggen

|

||||

* Repository aufrufen: <https://github.com/felixlohmeier/bibliotheks-und-archivinformatik>

|

||||

* Oben rechts auf Button "Fork" klicken

|

||||

|

||||

#### Schritt 2: Dateien herunterladen

|

||||

|

||||

Um die Dateien aus Ihrem Fork herunterzuladen ("klonen") geben Sie den folgenden Befehl ins Terminal ein.

|

||||

|

||||

Ersetzen Sie dabei `...` durch den Link zu Ihrem Fork.

|

||||

|

||||

```shell

|

||||

git clone ...

|

||||

```

|

||||

|

||||

Wechseln Sie in das erstellte Verzeichnis.

|

||||

|

||||

```shell

|

||||

cd bibliotheks-und-archivinformatik

|

||||

nano 01_technische-grundlagen.md

|

||||

```

|

||||

|

||||

|

||||

#### Schritt 3: Änderung lokal durchführen

|

||||

|

||||

Note:

|

||||

* Beim Aufruf des Programms nano wird das Terminal zu einem Texteditor.

|

||||

* Wir ergänzen eine Zeile in das leere Skript "Dies ist ein Test!"

|

||||

* Speichern und Verlassen des Texteditors

|

||||

* `STRG`+`X`

|

||||

* `y` ("yes" zu "save modified buffer"?)

|

||||

* Dateiname bestätigen zum Überschreiben der Datei

|

||||

1. Datei `README.md` in Texteditor öffnen und Link zu Ihrem Lerntagebuch in Abschnitt "Lerntagebücher" einfügen.

|

||||

|

||||

#### Änderung anzeigen

|

||||

2. Lassen Sie sich von `git` die Änderungen anzeigen:

|

||||

|

||||

```shell

|

||||

git diff

|

||||

```

|

||||

```shell

|

||||

git diff

|

||||

```

|

||||

|

||||

|

||||

3. Lassen Sie sich von `git` die geänderten Dateien anzeigen:

|

||||

|

||||

#### Lokaler Status

|

||||

```shell

|

||||

git status

|

||||

```

|

||||

|

||||

```shell

|

||||

git status

|

||||

```

|

||||

#### Schritt 4: Änderung hochladen

|

||||

|

||||

|

||||

1. Datei zum Päckchen hinzufügen

|

||||

|

||||

#### Datei zum Päckchen hinzufügen

|

||||

```shell

|

||||

git add README.md

|

||||

```

|

||||

|

||||

```shell

|

||||

git add 01_technische-grundlagen.md

|

||||

git status

|

||||

```

|

||||

2. Absender eintragen (mit Ihren Daten ersetzen)

|

||||

|

||||

|

||||

```shell

|

||||

git config user.email "mail@felixlohmeier.de"

|

||||

git config user.name "Felix Lohmeier"

|

||||

```

|

||||

|

||||

#### Absender eintragen

|

||||

3. Packzettel beilegen und Päckchen schließen

|

||||

|

||||

```shell

|

||||

git config user.email "mail@felixlohmeier.de"

|

||||

git config user.name "Felix Lohmeier"

|

||||

```

|

||||

```shell

|

||||

git commit -m "Link zu meinem Lerntagebuch"

|

||||

```

|

||||

|

||||

|

||||

4. Päckchen abschicken

|

||||

|

||||

Note:

|

||||

* Es werden Schreibrechte für das Git Repository benötigt, um Änderungen direkt einbringen zu können. Die Authentifizierung erfolgt über die E-Mail-Adresse.

|

||||

* Falls man keine Schreibrechte hat, kann man aber eine Kopie (Fork) erstellen, darein schreiben und anschließend einen sogenannten "Pull Request" stellen. Die Besitzerin des ursprünglichen Repositorys erhält dann eine Benachrichtigung und kann die Änderung übernehmen oder ablehnen. Das üben wir zum nächsten Termin.

|

||||

```shell

|

||||

git push

|

||||

```

|

||||

|

||||

#### Packzettel beilegen und Päckchen schließen

|

||||

#### Schritt 5: Pull Request erstellen

|

||||

|

||||

```shell

|

||||

git commit -m "Test Päckchen"

|

||||

```

|

||||

|

||||

|

||||

|

||||

#### Päckchen abschicken

|

||||

|

||||

```shell

|

||||

git status

|

||||

git push

|

||||

```

|

||||

|

||||

|

||||

* Mit wenigen Sekunden Verzögerung sollte Ihre Änderung nun auch bei GitHub angekommen sein.

|

||||

* Öffnen Sie Ihren Fork bei GitHub.

|

||||

* Klicken Sie auf den Link "Pull request". Dann erscheint ein Vergleich. Klicken Sie dort auf den Button "Create pull request".

|

||||

* Vervollständigen Sie das Formular und klicken Sie auf den Button "Create pull request".

|

||||

|

||||

#### Ergebnis auf GitHub

|

||||

|

||||

[Das Päckchen ("commit") bei GitHub](https://github.com/felixlohmeier/bibliotheks-und-archivinformatik/commit/caa6dc8dd640e0d1df86780288f84e0c47b81bef)

|

||||

Sie finden Ihren Pull Request im ursprünglichen Repository bei GitHub im Tab "Pull requests": <https://github.com/felixlohmeier/bibliotheks-und-archivinformatik/pulls>

|

||||

|

||||

|

||||

### Wofür git in Bibliotheken und Archiven?

|

||||

|

||||

### Blog mit GitHub Pages

|

||||

* Arbeitsfeld "forschungsnahe Dienste", siehe Positionspapier der Kommission für forschungsnahe Dienste des VDB: https://www.o-bib.de/article/view/5718/8434

|

||||

* siehe auch "Uses in a library context" in [Library Carpentry Lesson zu git](https://librarycarpentry.org/lc-git/01-what-is-git/index.html): "Local library looking to start a crowdsourcing project" und "Multiple people editing metadata for a collection"

|

||||

|

||||

## Blog mit GitHub Pages

|

||||

|

||||

* Mit GitHub Pages lassen sich statische Webseiten direkt aus den Dateien im GitHub Repository generieren und auf Servern von GitHub kostenfrei veröffentlichen.

|

||||

* GitHub verwendet dazu den (hauseigenen) Static-Site-Generator [Jekyll](https://help.github.com/en/github/working-with-github-pages/about-github-pages-and-jekyll).

|

||||

* Die Software nimmt Markdown- und HTML-Dateien und generiert daraus eine komplette Webseite.

|

||||

* Die Darstellung (Themes) lässt sich über eine Konfigurationsdatei einstellen.

|

||||

* [Vorlage für ein Lerntagebuch mit GitHub Pages](https://github.com/felixlohmeier/lerntagebuch) (mit Schritt-für-Schritt-Anleitung)

|

||||

* Siehe auch: [Interaktives Tutorial von GitHub](https://lab.github.com/githubtraining/github-pages)

|

||||

|

||||

### Übung: Pull Requests

|

||||

## Aufgaben

|

||||

|

||||

**Aufgabe (10 Minuten):** Link zum Lerntagebuch im Skript ergänzen

|

||||

Bis zum nächsten Termin:

|

||||

|

||||

1. Fork von Repository https://github.com/felixlohmeier/bibliotheks-und-archivinformatik erstellen ([Direktlink](https://github.com/felixlohmeier/bibliotheks-und-archivinformatik/fork ))

|

||||

2. Datei `README.md` in Ihrem Fork bearbeiten und Link zu Ihrem Lerntagebuch in [Abschnitt "Lerntagebücher"](https://github.com/felixlohmeier/bibliotheks-und-archivinformatik/blob/master/README.md#lerntageb%C3%BCcher) ergänzen

|

||||

3. Pull Request erstellen

|

||||

|

||||

Siehe auch: [Anleitung von GitHub](https://help.github.com/en/github/collaborating-with-issues-and-pull-requests/creating-a-pull-request-from-a-fork)

|

||||

|

||||

### Alternative zu GitHub: GitLab

|

||||

|

||||

* GitLab wird von einem kleinen Unternehmen entwickelt

|

||||

* basiert ebenfalls auf der Software git

|

||||

* Hat eine vergleichbare Funktion zu GitHub Pages: [GitLab Pages](https://docs.gitlab.com/ce/user/project/pages/)

|

||||

* Kann auf einem eigenen Server installiert werden

|

||||

* Vergleich von GitHub und GitLab: <https://www.heise.de/tipps-tricks/GitHub-vs-GitLab-4597154.html>

|

||||

1. Lerntagebuch einrichten

|

||||

* Vorlage für ein Lerntagebuch mit GitHub Pages: <https://github.com/felixlohmeier/lerntagebuch>

|

||||

* Link bitte auf der Übersichtsseite der gemeinsamen Dokumente ergänzen

|

||||

2. Einführungsartikel (wo bin ich gestartet?) (3000 - 4000 Zeichen)

|

||||

3. Beitrag zu dieser Lehreinheit "Technische Grundlagen" (3000 - 4000 Zeichen)

|

||||

|

||||

@ -2,34 +2,31 @@

|

||||

|

||||

* Metadatenstandards in Bibliotheken (MARC21)

|

||||

* Installation und Konfiguration von Koha

|

||||

* Cloud-Konzepte am Beispiel von ALMA

|

||||

* Marktüberblick Bibliothekssysteme

|

||||

|

||||

## Metadatenstandards in Bibliotheken (MARC21)

|

||||

|

||||

* MARC21: International verbreiteter Metadaten-Standard, begründet von der Library of Congress 1999: <https://www.loc.gov/marc/bibliographic/>

|

||||

* Hat ein [eigenes Binärformat](http://format.gbv.de/marc/iso) (.mrc), gibt's aber auch [als XML](http://format.gbv.de/marc/xml)

|

||||

* Hat [eigenes Binärformat](http://format.gbv.de/marc/iso) (.mrc), gibt's aber auch [als XML](http://format.gbv.de/marc/xml)

|

||||

* wegen unterschiedlicher Katalogisierungsregeln und der Möglichkeit eigene Felder zu belegen, weicht die Verwendung international und auch nach Institution [stark vom vermeintlichen Standard ab](https://docs.google.com/presentation/d/e/2PACX-1vRU4J_rln00UVD7pNPT0_02NOad0HfSk_UKqRI0v29y8QkMAplEDlyjc0Ot_VE_paV6WBW29Fh_V-iN/pub?start=false&loop=false&delayms=3000#slide=id.g574306292a_0_35)

|

||||

* wird zukünftig voraussichtlich von [BIBFRAME](http://format.gbv.de/bibframe), einem Datenmodell basierend auf [RDF](http://format.gbv.de/rdf), abgelöst

|

||||

* Koha und alle anderen großen Bibliothekssysteme basieren auf MARC21 oder unterstützen es als Austauschformat

|

||||

* wird zukünftig voraussichtlich von [BIBFRAME](http://format.gbv.de/bibframe), einem Datenmodell basierend auf [RDF](http://format.gbv.de/rdf), abgelöst

|

||||

|

||||

### Übung: Vergleich MARC21 und Dublin Core

|

||||

|

||||

* Dublin Core ist ein Standard, der als kleinster gemeinsamer Nenner gilt

|

||||

* Als Beispiele nutzen wir den Katalog der Bibliothek der FH Graubünden

|

||||

* Wir beziehen die Daten über die SRU-Schnittstelle von Swissbib (auf das Thema Schnittstellen und SRU gehen wir an einem anderen Tag noch ein)

|

||||

* Wir beziehen die Daten über die SRU-Schnittstelle von Swisscovery (auf das Thema Schnittstellen und SRU gehen wir an einem anderen Tag noch ein)

|

||||

|

||||

**Aufgabe (15 Minuten):** Laden Sie über das Formular auf der Webseite http://sru.swissbib.ch Daten mit den folgenden Parametern einmal im Format MARC21 und einmal im Format Dublin Core und vergleichen Sie diese.

|

||||

**Aufgabe (15 Minuten):** Laden Sie über die folgenden Links Daten über die SRU-Schnittstelle von Swisscovery einmal im Format MARC21 und einmal im Format Dublin Core und vergleichen Sie diese.

|

||||

|

||||

| Searchfield | value |

|

||||

| ------------------------ | ------------- |

|

||||

| dc.possessingInstitution | `E27` |

|

||||

| dc.title | `open access` |

|

||||

* MARC21: <https://swisscovery.slsp.ch/view/sru/41SLSP_NETWORK?version=1.2&operation=searchRetrieve&query=title=einstein&recordSchema=marcxml>

|

||||

* Dublin Core: <https://swisscovery.slsp.ch/view/sru/41SLSP_NETWORK?version=1.2&operation=searchRetrieve&query=title=einstein&recordSchema=dc>

|

||||

|

||||

Note:

|

||||

|

||||

- Das Projekt Swissbib sammelt Metadaten aller schweizer Universitätsbibliotheken, der Nationalbibliothek und einiger Kantonsbibliotheken sowie weiterer Institutionen.

|

||||

- Der gemeinsame Katalog ermöglicht eine übergreifende Suche, gleichzeitig bietet Swissbib auch Schnittstellen an, über welche Metadaten der teilnehmenden Institutionen zentral bezogen werden können.

|

||||

- Siehe auch: [Dokumentation Swissbib SRU](http://www.swissbib.org/wiki/index.php?title=SRU)

|

||||

- Der Katalog Swisscovery beinhaltet die Daten der an SLSP teilnehmenden Bibliotheken.

|

||||

- Der gemeinsame Katalog ermöglicht eine übergreifende Suche, gleichzeitig bietet Swisscovery auch Schnittstellen an, über welche Metadaten der teilnehmenden Institutionen zentral bezogen werden können.

|

||||

- Siehe auch: [Nutzung SLSP-Metadaten](https://slsp.ch/de/metadata), [Dokumentation der SRU-Schnittstelle von ALMA](https://developers.exlibrisgroup.com/alma/integrations/sru/)

|

||||

|

||||

## Installation und Konfiguration von Koha

|

||||

|

||||

@ -39,64 +36,97 @@ Note:

|

||||

* Weltweites Open Source Projekt, gegründet 1999 in Neuseeland, heute mit Beteiligung von Unternehmen wie ByWater Solutions, Biblibre, Catalyst IT, PTFS Europe, Theke Solutions

|

||||

* Status des Projekts: Siehe [Statistik bei Open Hub](https://www.openhub.net/p/koha)

|

||||

|

||||

Note:

|

||||

- Zur Gesundheit von Open-Source-Projekten siehe auch <https://felixlohmeier.de/slides/2017-09-28_vufind-anwendertreffen-keynote.html>

|

||||

- Zur Bedeutung von Open-Source-Software auch dieser Comic: <https://xkcd.com/2347/>

|

||||

|

||||

#### Koha Dokumentation

|

||||

|

||||

* Professionelle Entwicklungsstrukturen, vgl. Dashboard: <https://dashboard.koha-community.org>

|

||||

* Release Notes zur Version 19.11: <https://koha-community.org/koha-19-11-release/>

|

||||

* Handbuch zur Version 19.11: [englisch](https://koha-community.org/manual/19.11/en/html/), [deutsch](http://koha-community.org/manual/19.11/de/html/index.html) (noch nicht vollständig übersetzt)

|

||||

* Release Notes zur Version 21.05: <https://koha-community.org/koha-21-05-released/>

|

||||

* Handbuch zur Version 21.05: [englisch](https://koha-community.org/manual/21.05/en/html/), [deutsch](http://koha-community.org/manual/21.05/de/html/index.html) (Übersetzung noch in Arbeit)

|

||||

|

||||

#### Koha Demo

|

||||

|

||||

* MARC21, Koha 19.11 bereitgestellt von schweizer Unternehmen "Admin Kuhn"

|

||||

* [OPAC](http://koha.adminkuhn.ch/)

|

||||

* [Staff Interface](http://koha.adminkuhn.ch:8080/) (Benutzername `demo` / Passwort `demo`)

|

||||

* MARC21, Koha 21.05 bereitgestellt von schweizer Unternehmen "Admin Kuhn" unter http://koha.adminkuhn.ch

|

||||

* Login mit Benutzername `demo` / Passwort `demo` möglich

|

||||

* wird jeweils Morgens um 5 Uhr auf Standardwerte zurückgesetzt

|

||||

* siehe auch die Erläuterungen unter http://adminkuhn.ch/wiki/Koha-Demoinstallation

|

||||

|

||||

### Installation von Koha 19.11

|

||||

### Installation von Koha 21.05

|

||||

|

||||

Die folgenden Befehle orientieren sich an der [offiziellen Installationsanleitung](http://wiki.koha-community.org/wiki/Debian).

|

||||

|

||||

#### Paketquellen für Koha registrieren

|

||||

#### Paketquellen für Koha registrieren

|

||||

|

||||

1. Paketquelle hinzufügen

|

||||

|

||||

```shell

|

||||

echo 'deb http://debian.koha-community.org/koha 21.05 main' | sudo tee /etc/apt/sources.list.d/koha.list

|

||||

```

|

||||

|

||||

2. Schlüssel hinzufügen

|

||||

|

||||

```shell

|

||||

echo 'deb http://debian.koha-community.org/koha 19.11 main' | sudo tee /etc/apt/sources.list.d/koha.list

|

||||

wget -q -O- http://debian.koha-community.org/koha/gpg.asc | sudo apt-key add -

|

||||

```

|

||||

|

||||

3. Paketquellen aktualisieren

|

||||

|

||||

```shell

|

||||

sudo apt-get update

|

||||

```

|

||||

|

||||

#### Koha und die Datenbank MariaDB installieren

|

||||

#### Koha und die Datenbank MariaDB installieren

|

||||

|

||||

```shell

|

||||

sudo apt install koha-common mariadb-server

|

||||

```

|

||||

|

||||

#### Domain `meine-schule.org` für Koha konfigurieren

|

||||

#### Domain `meine-schule.org` für Koha konfigurieren

|

||||

|

||||

```shell

|

||||

sudo sed -i 's/DOMAIN=".myDNSname.org"/DOMAIN=".meine-schule.org"/' /etc/koha/koha-sites.conf

|

||||

```

|

||||

|

||||

#### Apache Konfiguration

|

||||

#### Apache Konfiguration

|

||||

|

||||

```shell

|

||||

sudo a2enmod rewrite

|

||||

sudo a2enmod cgi

|

||||

sudo service apache2 restart

|

||||

sudo a2enmod headers proxy_http

|

||||

sudo systemctl restart apache2

|

||||

```

|

||||

|

||||

#### Eine Bibliothek in Koha erstellen

|

||||

#### Eine Bibliothek in Koha erstellen

|

||||

|

||||

```shell

|

||||

sudo koha-create --create-db bibliothek

|

||||

```

|

||||

|

||||

#### Deutsche Übersetzung für Koha installieren

|

||||

#### Deutsche Übersetzung für Koha installieren

|

||||

|

||||

```shell

|

||||

sudo koha-translate --install de-DE

|

||||

```

|

||||

|

||||

Note:

|

||||

- Fehlermeldung ignorieren:

|

||||

|

||||

> `Connection to the memcached servers '__MEMCACHED_SERVERS__' failed`

|

||||

|

||||

#### "Plack" aktivieren für bessere Performance

|

||||

|

||||

```shell

|

||||

sudo koha-plack --enable bibliothek

|

||||

sudo koha-plack --start bibliothek

|

||||

sudo systemctl restart apache2

|

||||

```

|

||||

|

||||

#### Host-Datei ergänzen

|

||||

|

||||

Es handelt sich um einen einzigen Befehl. Anders als sonst müssen hier also alle vier Zeilen gemeinsam in die Kommandozeile übernommen werden.

|

||||

|

||||

```shell

|

||||

echo '# Koha

|

||||

127.0.0.1 bibliothek.meine-schule.org

|

||||

@ -104,37 +134,73 @@ echo '# Koha

|

||||

' | sudo tee -a /etc/hosts

|

||||

```

|

||||

|

||||

#### Befehl, um generiertes Passwort herauszufinden

|

||||

#### Befehl, um generiertes Passwort herauszufinden

|

||||

|

||||

```shell

|

||||

sudo koha-passwd bibliothek

|

||||

```

|

||||

|

||||

Kopieren Sie das Passwort in die Zwischenablage.

|

||||

|

||||

#### Fertig?

|

||||

|

||||

Wenn die Installation erfolgreich war, dann sollten Sie mit dem Browser auf dem virtuellen Server die Webseite http://bibliothek-intra.meine-schule.org aufrufen können. Dort sollte der Koha-Installationsassistent erscheinen.

|

||||

Wenn die Installation erfolgreich war, dann sollten Sie mit dem Browser auf der virtuellen Maschine die Webseite <http://bibliothek-intra.meine-schule.org> aufrufen können. Dort sollte der Koha-Installationsassistent erscheinen.

|

||||

|

||||

#### Bekanntes Problem

|

||||

|

||||

Aus noch unbekannten Gründen ist manchmal nach erfolgreicher Installation und etwas Wartezeit plötzlich Koha nicht mehr aufrufbar. Dann hilft ein Neustart von Koha:

|

||||

|

||||

```

|

||||

sudo systemctl restart koha-common

|

||||

```

|

||||

|

||||

#### Koha zurücksetzen

|

||||

|

||||

Falls etwas schiefgeht, können Sie die Konfiguration mit den folgenden Befehlen zurücksetzen. Es erscheint dann wieder der Webinstaller und Sie können von Vorne beginnen.

|

||||

|

||||

```shell

|

||||

sudo koha-remove bibliothek

|

||||

sudo koha-create --create-db bibliothek

|

||||

sudo koha-passwd bibliothek

|

||||

```

|

||||

|

||||

Note:

|

||||

- Falls das auch nicht funktioniert, ist vermutlich ein Rest der eingerichteten Bibliothek noch vorhanden. Mit folgenden Befehlen können Sie auch diese Reste löschen. Anschließend sollte das Neuanlegen funktionieren.

|

||||

- `sudo koha-remove --purge-all bibliothek`

|

||||

- `sudo userdel bibliothek-koha`

|

||||

|

||||

### Grundkonfiguration mit Tutorial

|

||||

|

||||

Wir verwenden ein Tutorial von Stephan Tetzel, das auf deutsch und englisch verfügbar ist:

|

||||

|

||||

* Deutsch: <https://zefanjas.de/wie-man-koha-installiert-und-fuer-schulen-einrichtet-teil-1/>

|

||||

* Englisch: <https://openschoolsolutions.org/how-to-install-and-set-up-koha-for-schools-part-1/>

|

||||

* Deutsch: <https://zefanjas.de/wie-man-koha-installiert-und-fuer-schulen-einrichtet-teil-1/>

|

||||

* Englisch: <https://openschoolsolutions.org/how-to-install-and-set-up-koha-for-schools-part-1/>

|

||||

|

||||

**Aufgabe (45 Minuten)**: Bitte bearbeiten Sie das Tutorial, um die Grundkonfiguration von Koha vorzunehmen. Das Tutorial besteht aus 6 Kapiteln (die Links zu den weiteren Kapiteln sind immer am Anfang der Blogartikel):

|

||||

Note:

|

||||

- Da wir eine neuere Koha-Version (21.05) als im Tutorial 20.05 verwenden, gibt es Abweichungen im Detail. Das ist eine Situation, die in der Praxis oft auftritt. Versuchen Sie die Hinweise im Tutorial sinngemäß anzuwenden.

|

||||

|

||||

**Aufgabe**: Bitte bearbeiten Sie das Tutorial, um die Grundkonfiguration von Koha vorzunehmen. Das Tutorial besteht aus 6 Kapiteln (die Links zu den weiteren Kapiteln sind immer am Anfang der Blogartikel):

|

||||

|

||||

1. Installation und Einrichtung einer ersten Bibliothek

|

||||

* Die im Tutorial erwähnte Grundinstallation haben wir oben bereits durchgeführt. Bitte starten Sie in Kapitel 1 unter der Überschrift "Koha einrichten": <https://zefanjas.de/wie-man-koha-installiert-und-fuer-schulen-einrichtet-teil-1/>

|

||||

* Die Grundinstallation haben wir bereits durchgeführt. Starten Sie in [Kapitel 1](https://zefanjas.de/wie-man-koha-installiert-und-fuer-schulen-einrichtet-teil-1/) unter der Überschrift "Koha einrichten".

|

||||

2. Das bibliografische Framework

|

||||

* Hier bitte nur lesen, den Export/Import nicht durchführen.

|

||||

* Dieses Kapitel bitte nur lesen und den Export/Import **nicht** durchführen. Das im Tutorial beschriebene Vorgehen ist fehleranfällig.

|

||||

3. Grundeinstellungen

|

||||

* Mit der Koha-Version 20.05 wurde der Parameter "OpacMainUserBlock" für die Willkommensnachricht von den Systemeinstellungen in das Nachrichten-Werkzeug verschoben (Werkzeuge > Nachrichten > Neuer Eintrag).

|

||||

|

||||

Optional:

|

||||

|

||||

4. Buchaufnahme

|

||||

5. Drucken von Etiketten

|

||||

6. Ausleihkonditionen

|

||||

|

||||

Note:

|

||||

- Koha bietet eine Bearbeitungsfunktion des bibliografischen Frameworks direkt über die Webseite der Admin-Oberfläche (ohne Export/Import). Menüpunkt "MARC-Struktur".

|

||||

- Der Parameter für die Willkommensnachricht wurde von den Systemeinstellungen in das Nachrichten-Werkzeug verschoben. Werkzeuge > Nachrichten > Neuer Eintrag. Anzeigebereich: OpacMainUserBlock

|

||||

|

||||

### Übung: Manuelle Bedienung

|

||||

|

||||

**Aufgabe (15 Minuten)**: Damit Sie ein Gespür für das System erhalten, machen wir nun ein Minimalbeispiel für einen vereinfachten Bibliotheksworkflow:

|

||||

**Aufgabe (20 Minuten)**: Damit Sie ein Gespür für das System erhalten, machen wir nun ein Minimalbeispiel für einen vereinfachten Bibliotheksworkflow:

|

||||

|

||||

1. Buch erfassen

|

||||

2. Benutzer anlegen

|

||||

@ -154,6 +220,18 @@ Start > Katalogisierung > Neuer Titel > Schnellaufnahme

|

||||

* `p - Barcode` muss vergeben werden (sonst können wir später nicht ausleihen)

|

||||

* Unten Button "Exemplar hinzufügen" nicht vergessen

|

||||

|

||||

Note:

|

||||

- Falls bei der Grundinstallation der Import des FA-Frameworks nicht durchgeführt wurde, steht keine Schnellaufnahme zur Verfügung.

|

||||

- Nachinstallation des FA-Frameworks:

|

||||

1. Im Terminal das Framework herunterladen:

|

||||

```bash

|

||||

wget https://raw.githubusercontent.com/sebastian-meyer/bain_fa/master/export_FA.csv

|

||||

```

|

||||

2. In der Koha-Dienstoberfläche: Start -> Administration -> Bibliographisches MARC-Framework

|

||||

3. Button "Neues Framework": Code "FA", Beschreibung "Schnellaufnahme"

|

||||

4. Rechts neben dem neu angelegten Framework über den Pfeil auf "Import"

|

||||

5. Datei "export_FA.csv" auswählen und bestätigen

|

||||

|

||||

#### Benutzer anlegen

|

||||

|

||||

* Start > Benutzer > Benutzer-Schnellerfassung

|

||||

@ -163,30 +241,34 @@ Start > Katalogisierung > Neuer Titel > Schnellaufnahme

|

||||

|

||||

* Oben im Suchschlitz Reiter Ausleihe wählen, Ausweisnummer eingeben und abschicken

|

||||

* Dann in Box "Ausleihe an" den Exemplarbarcode eingeben und Ausleihe abschicken

|

||||

* Über Button "Zeige Ausleihen" prüfen, ob Ausleihe erfolgreich war

|

||||

|

||||

#### Buch an Theke zurücknehmen

|

||||

|

||||

* Oben im Suchschlitz Reiter Rückgabe wählen, Barcode eingeben und abschicken

|

||||

|

||||

### Übung: Datenimport und Export

|

||||

### Übung: Datenimport

|

||||

|

||||

**Aufgabe (15 Minuten)**: Koha verfügt über einige Schnittstellen. Hier ein kleines Beispiel für semi-automatische Erfassung ("copy cataloging"):

|

||||

**Aufgabe (20 Minuten)**: Koha verfügt über einige Schnittstellen. Hier ein kleines Beispiel für semi-automatische Erfassung ("copy cataloging"):

|

||||

|

||||

1. Z39.50 Server einrichten

|

||||

2. "Copy Cataloging"

|

||||

3. Datenexport

|

||||

|

||||

#### Z39.50 Server einrichten

|

||||

#### SRU Server einrichten

|

||||

|

||||

Start > Administration > Z39.50/SRU-Server / Neuer Z39.50-Server

|

||||

Start > Administration > Z39.50/SRU-Server / Neuer SRU-Server

|

||||

|

||||

* Servername: `NEBIS`

|

||||

* Hostname: `opac.nebis.ch`

|

||||

* Port: `9909`

|

||||

* Servername: `GBV`

|

||||

* Hostname: `sru.gbv.de`

|

||||

* Port: `80`

|

||||

* Ausgewählt (Standardsuche): ja

|

||||

* Datenbank: `NEBIS`

|

||||

* Datenbank: `gvk`

|

||||

* Syntax: `MARC21/USMARC`

|

||||

* Codierung: `MARC-8`

|

||||

* Codierung: `utf8`

|

||||

|

||||

Note:

|

||||

- Im Netzwerk der FHGR sind aus Sicherheitsgründen einige Ports gesperrt. Daher können wir mit unserer virtuellen Maschine einige Z39.50 Server wie z.B. von NEBIS auf Port 9909 nicht erreichen.

|

||||

|

||||

#### "Copy Cataloging"

|

||||

|

||||

@ -197,33 +279,101 @@ Start > Katalogisierung > Import über Z39.50/SRU

|

||||

* Im folgenden Katalogisierungsbildschirm können Sie versuchen zu speichern. Es muss aber auf jeden Fall noch der Medientyp in Feld `942c` ausgewählt werden (ein Pflichtfeld).

|

||||

* Im nächsten Bildschirm einen Barcode vergeben und Exemplar hinzufügen.

|

||||

|

||||

#### Datenexport

|

||||

### Exkurs: Datenexport und Schnittstellen

|

||||

|

||||

Start > Werkzeuge > Datenexport

|

||||

* Koha unterstützt dateibasierten Datenexport und diverse Schnittstellen.

|

||||

* Wir nutzen hier die Schnittstelle OAI-PMH.

|

||||

* OAI-PMH steht für [Open Archives Initiative Protocol for Metadata Harvesting](https://www.openarchives.org/pmh/) und ermöglicht regelmäßiges automatisiertes Abrufen von Änderungen.

|

||||

* Im Themenblock "Metadaten modellieren und Schnittstellen nutzen" gehen wir noch genauer darauf ein.

|

||||

|

||||

* Dateiformat: `XML`

|

||||

* Dateiname: `koha.xml`

|

||||

* Download speichern (landet im Ordner `/home/bain/Downloads`)

|

||||

Note:

|

||||

- Vorab: Was nützt OAI-PMH meiner Bibliothek?

|

||||

- Abruf der Daten zur Weiterverarbeitung (z. B. Discovery-System, Digitalisierung)

|

||||

- Erstellung von z. B. Regionalbibliografien oder Themenportalen

|

||||

- Aggregation für Verbundrecherchen

|

||||

- Datenbereitstellung für Digitalisierung, Hackathons, etc.

|

||||

|

||||

### Übung: OAI-PMH

|

||||

|

||||

**Aufgabe (20 Minuten)**: Aktivieren Sie die OAI-PMH-Schnittstelle und prüfen Sie, ob die von Ihnen erstellten Datensätze darüber abrufbar sind

|

||||

|

||||

#### Schnittstelle einrichten

|

||||

|

||||

Start > Administration > Globale Systemparameter > Web Services

|

||||

* OAI-PMH: Aktiviere

|

||||

* OAI-PMH:AutoUpdateSets: Aktiviere

|

||||

* Button "Alle Web Services Parameter speichern"

|

||||

* Siehe auch: <https://koha-community.org/manual/21.05/en/html/administration.html#oai-sets-configuration>

|

||||

|

||||

#### Schnittstelle abfragen

|

||||

|

||||

* Die Basisurl lautet bei uns: <http://bibliothek.meine-schule.org/cgi-bin/koha/oai.pl>

|

||||

* Klicken Sie oben auf die Links "Identify", "Metadata Formats" usw.

|

||||

* Prüfen Sie, ob die von Ihnen erstellten Katalogeinträge abrufbar sind

|

||||

|

||||

### Literatur

|

||||

|

||||

* Koha Anwenderhandbuch des Bibliothekservice-Zentrum Baden-Württemberg: <https://wiki.bsz-bw.de/doku.php?id=l-team:koha:koha-handbuch:start> (für ältere Versionen geschrieben)

|

||||

* Koha Anwenderhandbuch des Bibliothekservice-Zentrum Baden-Württemberg: <https://wiki.bsz-bw.de/display/KOHA/Dokumentation> (für ältere Versionen geschrieben)

|

||||

* Felix Hemme (2016): Katalogisierung mit dem Open-Source-Bibliothekssystem Koha – unter Berücksichtigung des Metadatenstandards MARC 21 und dem Regelwerk RDA. Bachelorarbeit im Studiengang Bibliotheksmanagement der FH Potsdam. <https://nbn-resolving.org/urn:nbn:de:kobv:525-13882>

|

||||

* Implementation Checklist: <https://koha-community.org/manual/19.11/en/html/implementation_checklist.html>

|

||||

* Implementation Checklist: <https://koha-community.org/manual/21.05/en/html/implementation_checklist.html>

|

||||

* Fred King: How to use Koha, MarcEdit, a Raspberry Pi, and a Chicken (optional) to create an ILS for under $100 (September 2019, Vortrag auf Koha-Konferenz): <http://avengingchicken.online/misc/installing_koha_on_raspberry-pi-4.pdf>

|

||||

|

||||

## Cloud-Konzepte am Beispiel von ALMA

|

||||

|

||||

### Verwendung von ALMA an der Fachhochschule Nordwestschweiz (FHNW)

|

||||

|

||||

Notizen zur Live-Demo:

|

||||

|

||||

* Aufbau und Grundlagen: jede SLSP-Bibliothek hat eigene Einstiegsseite in ALMA-Administration

|

||||

* Recherche in Alma / Primo VE: Komplexe Suchoptionen möglich, Anzeige der Treffer ähnlich wie in Discovery-System

|

||||

* Ausleihe und Rückgabe: System verlangt zunächst "Login" an einem Standort, bevor Benutzungsfunktionen angezeigt werden

|

||||

* Benutzerverwaltung: SLSP hat Rollenvorlagen für Mitgliedsbibliotheken erstellt

|

||||

* E-Ressourcen:

|

||||

* Übernahme von Daten aus verschiedenen Schnittstellen möglich. Die meisten Verlage liefern Daten direkt an Ex Libris.

|

||||

* Bestandszeitraum kann "überschrieben" werden

|

||||

* Datenbanken können oft auch im Volltext durchsucht werden.

|

||||

* Konfiguration:

|

||||

* Öffnungszeiten bestimmen den Ablauf der Ausleihfristen. Kann für jede Bibliothek definiert werden.

|

||||

* Die meisten Einstellungen werden an der FHNW auf der Ebene der "Institution Zone" vorgenommen. Beispiel "Briefe" (inkl. E-Mail) zur Nutzerkommunikation

|

||||

* Discovery kann direkt aus ALMA konfiguriert werden. Template (HTML, CSS, JS) kann mit "Primo Studio" erstellt werden. <https://fhnw.swisscovery.slsp.ch>

|

||||

* Benutzerverwaltung: SLSP hat Rollenvorlagen für Mitgliedsbibliotheken erstellt

|

||||

|

||||

### Zusammenspiel Verbund und lokale Änderungen

|

||||

|

||||

> Was passiert, wenn Datensätze in der Community aktualisiert werden, für die lokale "Überschreibungen" vorgenommen wurden?

|

||||

|

||||

Lokale Änderung wird überschrieben und in einer Liste (CZ-Updates - Aufgabenliste) zur Kontrolle notiert

|

||||

|

||||

### Übung: Strategische Spielereien

|

||||

|

||||

Gruppe 1: Argumentation gegenüber Träger / Direktion

|

||||

* Ihr müsst eurer Direktion / dem Träger ein Systemwechsel zu ALMA / SLSP vorschlagen, welche Argumente führt ihr auf?

|

||||

* Wie rechtfertigen wir den sehr viel höheren Mitteleinsatz gegenüber den Trägern und der Direktion?

|

||||

* Seht Ihr Alternativen?

|

||||

|

||||

Gruppe 2: Motivation und Kommunikation der beteiligten Bibliotheken

|

||||

* Wie würdet Ihr die Bibliotheken miteinbeziehen?

|

||||

* Wie würdet Ihr den Change begleiten?

|

||||

* Welche Kommunikationskanäle würdet Ihr nutzen?

|

||||

|

||||

Gruppe 3: Technische Alternativen Pro und Contra

|

||||

* Welche Vor- und Nachteile gibt es bei einem cloudbasierten System?

|

||||

* Gibt es Alternativen zu ALMA / SLSP

|

||||

* Wie beurteilt ihr die Konfigurationsmöglichkeiten?

|

||||

|

||||

## Marktüberblick Bibliothekssysteme

|

||||

|

||||

### Statistiken zum Markt USA/UK

|

||||

|

||||

* Marshall Breeding veröffentlicht jährlich im American Libraries Magazine den "Library Systems Report" und erfasst dafür regelmäßig Statistiken. Daran lässt sich die internationale Entwicklung der Produkte am ehesten ablesen.

|

||||

* [Zusammenfassende Tabellen mit aktuellen Statistiken (2019)](https://americanlibrariesmagazine.org/wp-content/uploads/2019/04/2019-Library-Systems-Report-Tables-UPDATED.pdf)

|

||||

* Vollständiger Bericht: Marshall Breeding (1.5.2019): Library Systems Report 2019. Cycles of innovation. In: American Libraries Magazine. <https://americanlibrariesmagazine.org/2019/05/01/library-systems-report-2019/>

|

||||

* [Zusammenfassende Tabellen mit aktuellen Statistiken (2020)](https://americanlibrariesmagazine.org/wp-content/uploads/2021/04/Library-Systems-Report-2021-Tables-and-Charts.xlsx)

|

||||

* Vollständiger Bericht: Marshall Breeding (3.5.2021): Library Systems Report 2021. Advancing library technologies in challenging times. In: American Libraries Magazine. https://americanlibrariesmagazine.org/2021/05/03/2021-library-systems-report/

|

||||

|

||||

### Aktuelle Entwicklungen

|

||||

|

||||

* Swiss Library Service Platform (SLSP) wird Alma (reines Cloud-Angebot, Server wird in Amsterdam stehen) einführen

|

||||

* Größte Open-Source-Alternative in Entwicklung: [FOLIO](https://www.folio.org)

|

||||

Note:

|

||||

- kurz nach Erscheinen des Berichts wurde ProQuest/ExLibris von Clarivate aufgekauft

|

||||

- Sachliche Einordnung: https://americanlibrariesmagazine.org/blogs/the-scoop/clarivate-to-acquire-proquest/

|

||||

- zugespitzter Kommentar: https://librarianshipwreck.wordpress.com/2021/08/16/mergers-acquisitions-and-my-tinfoil-hat/

|

||||

- Übersicht über vergangene Fusionen und Aufkäufe: https://librarytechnology.org/mergers/

|

||||

|

||||

### Alma im Vergleich zu Aleph und Koha

|

||||

|

||||

@ -231,4 +381,69 @@ Start > Werkzeuge > Datenexport

|

||||

* Siehe dazu Vortrag von Katrin Fischer: [Koha und ERM - Optionen für die Verwaltung von elektronischen Ressourcen](https://nbn-resolving.org/urn:nbn:de:0290-opus4-35840) auf dem Bibliothekartag 2018.

|

||||

* Alma ist auf dem aktuellsten Stand der Technik und bietet vorbildliche Programmierschnittstellen.

|

||||

* Alma ist cloudbasiert, d.h. zentrale Installation auf Servern von Ex Libris und regelmäßige Updates.

|

||||

* Kritiker befürchten langfristig Nachteile durch die Abhängigkeit vom Hersteller Ex Libris und dessen Marktmacht (Vendor-Lock-in).

|

||||

* Kritiker befürchten langfristig Nachteile durch die Abhängigkeit vom Hersteller Ex Libris und dessen Marktmacht (Vendor Lock-in).

|

||||

|

||||

### Wann wird ein ERM-System benötigt?

|

||||

|

||||

* Klassische Bibliothekssysteme können auch einzelne E-Books, digitale Hörbücher etc. verwalten

|

||||

* Manchmal werden Schnittstellen angeboten, um eBooks aus großen Plattformen wie OverDrive zu übernehmen

|

||||

* ERM-Systeme benötigen insbesondere wissenschaftliche Bibliotheken, weil diese "Pakete" von verschiedenen Anbietern erwerben, in denen eine so große Anzahl von elektronischen Zeitschriften und/oder E-Books enthalten ist, dass diese nicht mehr einzeln katalogisiert werden.

|

||||

|

||||

### Unterschiede zwischen wiss. und öff. Bibliothekssoftware

|

||||

|

||||

- Traditionell gibt es große Unterschiede zwischen wissenschaftlichen und öffentlichen Bibliotheken (darunter Schulbibliotheken)

|

||||

- Bibliotheksmanagementsoftware für öffentliche Bibliotheken enthält oft Module für Veranstaltungsmanagement oder Content-Management (Webseiten), legt Schwerpunkte auf optischer Darstellung (Buchcover, Themenschwerpunkte) und bindet Plattformen für E-Books und Hörbücher ein.

|

||||

- Bibliotheksmanagementsoftware für wissenschaftliche Bibliotheken legt Schwerpunkte auf Erschließung, E-Ressourcen-Management (elektronische Zeitschriften) und komplexe Geschäftsgänge

|

||||

|

||||

## Aufgaben

|

||||

|

||||

Bis zum nächsten Termin:

|

||||

|

||||

1. Beitrag im Lerntagebuch zu dieser Lehreinheit (3000 - 4000 Zeichen)

|

||||

2. Installation ArchivesSpace (siehe unten)

|

||||

|

||||

### Installation ArchivesSpace 3.1.0

|

||||

|

||||

1. Java 8 installieren

|

||||

|

||||

```bash

|

||||

sudo apt update

|

||||

sudo apt install openjdk-8-jre-headless

|

||||

```

|

||||

|

||||

2. Zip-Archiv herunterladen und entpacken

|

||||

|

||||

```bash

|

||||

wget https://github.com/archivesspace/archivesspace/releases/download/v3.1.0/archivesspace-v3.1.0.zip

|

||||

unzip -q archivesspace-v3.1.0.zip

|

||||

```

|

||||

|

||||

3. ArchivesSpace starten

|

||||

|

||||

```bash

|

||||

archivesspace/archivesspace.sh

|

||||

```

|

||||

|

||||

Note:

|

||||

- Während Koha in der Standardinstallation so eingerichtet ist, dass es automatisch beim Systemstart zur Verfügung steht, muss ArchivesSpace in der Standardinstallation manuell gestartet werden.

|

||||

- Es ist nur solange verfügbar wie der Prozess im Terminal läuft. Es handelt sich um eine Webanwendung. Im Terminal läuft die Server-Applikation. Über den Browser greifen wir darauf zu. Wenn das Terminal geschlossen wird, dann wird auch der Server beendet und die Webseite im Browser ist nicht mehr erreichbar.

|

||||

|

||||

### ArchivesSpace aufrufen

|

||||

|

||||

Nach ein paar Minuten sollte ArchivesSpace unter folgenden URLs erreichbar sein:

|

||||

|

||||

* http://localhost:8080/ – Administrationsoberfläche / "Staff Interface"

|

||||

* http://localhost:8081/ – Benutzungsoberfläche / "Public Interface"

|

||||

* http://localhost:8082/ – OAI-PMH Schnittstelle

|

||||

|

||||

Zugangsdaten für das "Staff Interface" sind:

|

||||

|

||||

* Username: `admin`

|

||||

* Password: `admin`

|

||||

|

||||

Note:

|

||||

- Die Benutzungsoberfläche ist erst verfügbar, wenn über die Administrationsoberfläche mindestens ein Repository angelegt wurde. (Das machen wir in der nächsten Lehreinheit.)

|

||||

- Da es sich um eine lokale Installation handelt, sind die Adressen nur über den Webbrowser innerhalb der Virtuellen Maschine erreichbar.

|

||||

- Für technisch Interessierte:

|

||||

- Unter http://localhost:8089/ ist die [REST API](https://archivesspace.github.io/archivesspace/api/) erreichbar.

|

||||

- Unter http://localhost:8090/ ist die Suchmaschine Apache Solr erreichbar.

|

||||

|

||||

@ -1,17 +1,12 @@

|

||||

# Funktion und Aufbau von Archivsystemen

|

||||

|

||||

* Metadatenstandards in Archiven (ISAD(G) und EAD) (45 Minuten)

|

||||

* Installation und Konfiguration von ArchivesSpace (125 Minuten)

|

||||

* Marktüberblick Archivsysteme (10 Minuten)

|

||||

* Metadatenstandards in Archiven (ISAD(G) und EAD)

|

||||

* Installation und Konfiguration von ArchivesSpace

|

||||

* Marktüberblick Archivsysteme

|

||||

|

||||

## Metadatenstandards in Archiven (ISAD(G) und EAD)

|

||||

|

||||

1. ISAD(G) (15 Minuten)

|

||||

2. Übung Archivkataloge (20 Minuten)

|

||||

3. EAD (5 Minuten)

|

||||

4. Aktuelle Entwicklungen (5 Minuten)

|

||||

|

||||

### ISAD(G)

|

||||

### Regelwerk: ISAD(G)

|

||||

|

||||

* Als digitale Archivsysteme entwickelt wurden, orientierte sich die Datenstruktur an analogen Findmitteln wie Findbüchern und Zettelkästen.

|

||||

* Ein wichtiger Verzeichnungsstandard im Archivwesen wurde 1994 (Revision 2000) eingeführt, die "International Standard Archival Description (General)" - kurz [ISAD(G)](https://de.wikipedia.org/wiki/ISAD(G)).

|

||||

@ -48,40 +43,40 @@ Von besonderer Bedeutung sind 6 Pflichtfelder:

|

||||

|

||||

#### Normdaten mit ISAD(G)

|

||||

|

||||